【TechWeb】8 月 27 日消息,通义万相又迎来重磅开源,全新发布的音频驱动的视频模型 Wan2.2-S2V 仅需一张图片和一段音频,即可生成面部表情自然、口型一致、肢体动作丝滑电影级数字人视频。模型生成视频时长可达分钟级,可大幅提升数字人直播、影视制作、AI 教育等行业的视频创作效率。

据介绍,Wan2.2-S2V 可驱动真人、卡通、动物、数字人等多种类型图片,并支持肖像、半身以及全身等任意画幅,上传一段音频后,模型就能让图片中的主体形象完成说话、唱歌和表演等动作。

通义团队基于通义万相的通用视频生成能力,融合了文本引导的全局运动控制和音频驱动的细粒度局部运动,实现了复杂场景的音频驱动视频生成;引入 AdaIN 和 CrossAttention 两种控制机制,实现了更准确更动态的音频控制效果。

生成时长上,Wan2.2-S2V 单次生成的视频时长可达分钟级。

Wan2.2-S2V 通过层次化帧压缩技术,大幅降低了历史帧的 Token 数量,通过该方式将 motion frames(历史参考帧) 的长度从数帧拓展到 73 帧, 从而实现了稳定的长视频生成效果。

Wan2.2-S2V 还支持文本控制,输入 Prompt 后还可对视频画面进行控制,实现镜头运动、角色轨迹和实体间互动,让视频主体的运动和背景的变化更丰富。

同时通过多分辨率训练、支持模型多分辨率的推理,Wan2.2-S2V 可支持不同分辨率场景的视频生成需求, 如竖屏短视频、横屏影视剧。

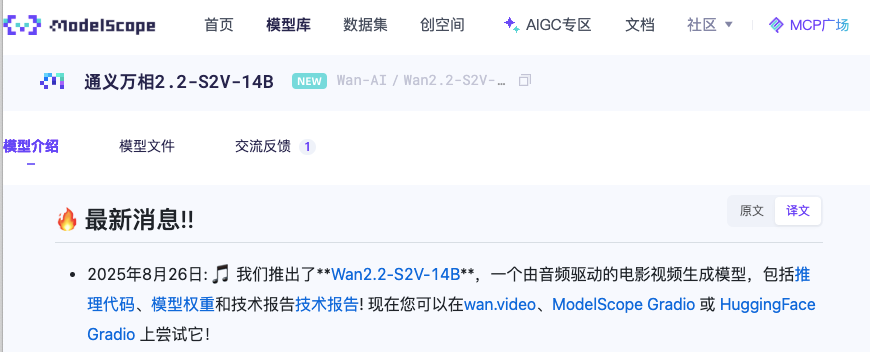

目前,用户可在 Github、HuggingFace 和魔搭社区下载模型,通过阿里云百炼调用 API,或在通义万相官网直接体验。